@WitzelJo wird hier Erfahrungen mit den

dokumentieren - vielen Dank!

Hinweis: auf forum.netzwissen.de sind diese Funktionen nicht installiert. Das kann sich ändern, sobald large language models (LLM) aus Europa zur Integration in Discourse zur Verfügung stehen (z.B. openGPT-X (OpenGPT-X) , https://laion.ai/ oder https://openeurollm.eu/)

Hinweis: auf forum.netzwissen.de sind diese Funktionen nicht installiert. Das kann sich ändern, sobald large language models (LLM) aus Europa zur Integration in Discourse zur Verfügung stehen (z.B. openGPT-X (OpenGPT-X) , https://laion.ai/ oder https://openeurollm.eu/)

Zuletzt bearbeitet von @mainmod 2025-03-06T16:30:47Z

Zunächst der Kontext: das das-gruene-forum.de wird aktuell bei www.purwin-it.de in der Hetzner-Cloud gehostet. Unser Provider hat uns jetzt auf Anfrage das KI-Plugin installiert. Ziel ist dieses Feature in den teilweise sehr langen Themen mit um die 1000 Beiträgen für Zusammenfassungen zu nutzen.

Dazu muss ich aber erstmal durch die Konfiguration durchsteigen. Hier in diesem Thema möchte ich über meine Erfahrungen damit berichten.

PS: Das Forum ist übrigens nicht mehr mir. Es gibt jetzt einen Trägerverein.

1 „Gefällt mir“

Also ich habe jetzt angefangen mich einzulesen. Dabei ist mir ein gutes Beispiel für die Funktion, die wir verwenden wollen über den Weg gelaufen: Zusammenfassen von Diskusisonen:

Beachte: Es nicht um das Thema der Diskussion, sondern um die verlinkte Zusammenfassung!

1 „Gefällt mir“

hmmja… Das ist ja die Discourse Instanz von OpenAI selber. Geht es da um ein Plugin, das die sich intern gebaut haben? Oder um Funktionen, die in das offizielle AI Plugin von CDCK eingeflossen sind? Also jenes auf Discourse AI - Plugin - Discourse Meta bzw. GitHub - discourse/discourse-ai

Wie schon geschrieben: die Integration von AI Funktionen in eine self-hosted Discourse Instanz ist bis auf weiteres alles andere als trivial. Siehe dazu Discourse AI - Self-Hosted Guide - Self-Hosting - Discourse Meta

Ich werde abwarten, wie sich das entwickelt. AI Funktionen für Discourse werden dann interessant, wenn sie

a) Teil des offiziellen Open Source Codes sind (siehe oben)

b) als AI Backend statt amerikanischer LLMs bzw. ihrer (kostenpflichtigen) APIs auch europäische LLMs ausgewählt werden können (z.B. https://laion.ai)

c) und das self-hosting von LLMs „bezahlbar“ wird. Sowohl im Sinne von Kosten wie im Sinne von Ressourcen

Es gab dazu mehrere Artikel auf heise.de bzw. heise+. Z.B. hier in 2023:

Künstliche Intelligenz: Wo man das eigene generative Sprachmodell betreiben kann | heise online

1 „Gefällt mir“

@WitzelJo

Ich setze gerade eine neue Discourse Instanz als Entwicklungsumgebung auf https://forum2.netzwissen.de auf. Sobald die Maschine läuft, will ich dort mit dem AI Plugin und verschiedenen LLMs experimentieren. Der Setup ist ansonsten derselbe wie in der produktiven Instanz

Fernziel ist der Einsatz eines europäischen LLM, siehe dazu Sprachmodelle: Deutschlands Aufholjagd gegenüber den USA und China | heise online

2 „Gefällt mir“

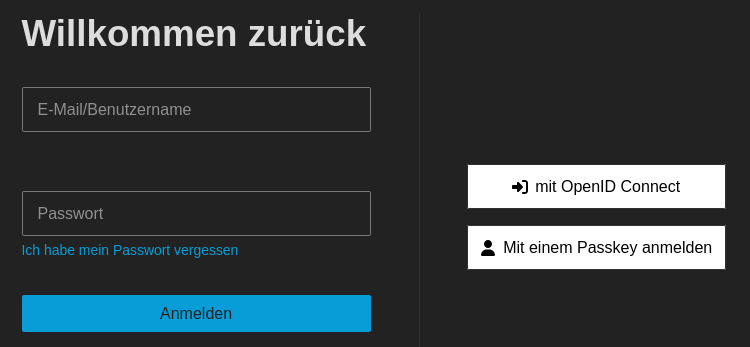

https://forum2.netzwissen.de/ ist in Betrieb. Bitte beachten:

- Die Instanz ist als Test-Umgebung gedacht und kann jederzeit ausfallen

- Selbst-Registrierung ist möglich.

- Es gibt keine Domänen-Anmeldung (OIDC/Oauth)

- die Basis-Ausstattung (Plugins, Themes) ist die gleiche wie bei forum.netzwissen.de, kann sich aber ändern

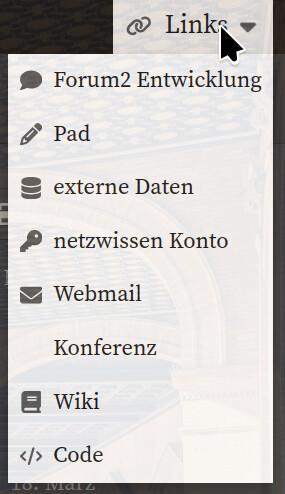

Das Test Forum2 ist über das Menü oben rechts erreichbar:

Die Domänen Anmeldung wurde nachgepflegt. Wer ein @netzwissen.de Konto hat, kann die gleiche Anmeldung in beiden Foren nutzen. Bei der ersten Anmeldung wird das lokale Konto auf forum2 automatisch erzeugt (auto-provisioning)

Hinweis: auf forum.netzwissen.de sind diese Funktionen nicht installiert. Das kann sich ändern, sobald large language models (LLM) aus Europa zur Integration in Discourse zur Verfügung stehen (z.B. openGPT-X (OpenGPT-X) , https://laion.ai/ oder https://openeurollm.eu/)